Αυτή η επέκταση του Chrome σας βοηθά να ανιχνεύσετε τα AI Deepfakes

Έχετε αναρωτηθεί ποτέ αν μια εγγραφή βίντεο ή ήχου έγινε από AI για να σας ξεγελάσει και να σας κάνει να νομίζετε ότι είναι αληθινή; Λοιπόν, τώρα υπάρχει μια επέκταση του προγράμματος περιήγησης Chrome για αυτό.

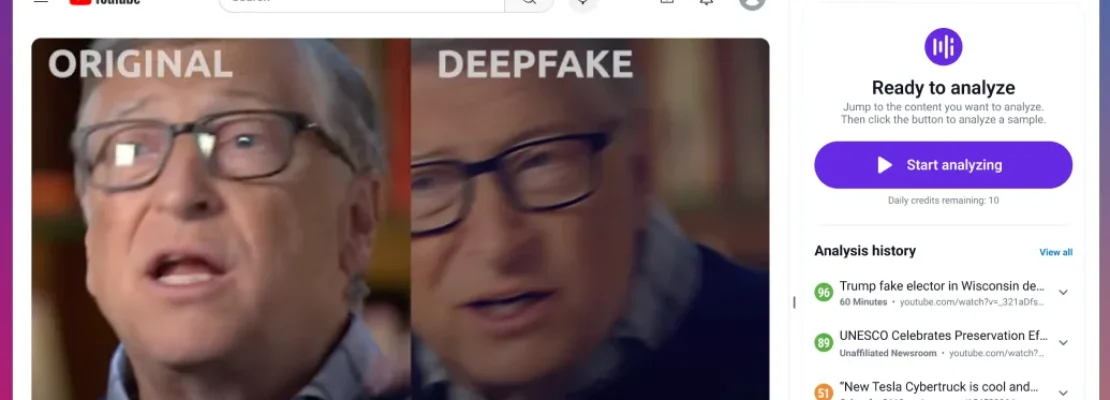

Το Deepfake Voice Detector της Hiya είναι μια επέκταση που μπορεί να ανιχνεύσει ήχο που έχει δημιουργηθεί από τεχνητή νοημοσύνη και είναι deepfaked σχεδόν οπουδήποτε στο διαδίκτυο, συμπεριλαμβανομένων των βίντεο ή των ηχογραφήσεων που δημοσιεύονται στο X/Twitter, το YouTube και το Facebook. Απαιτεί μια επαληθευμένη διεύθυνση ηλεκτρονικού ταχυδρομείου για τη δημιουργία λογαριασμού, προκειμένου να έχετε πρόσβαση σε αυτό μετά την εγκατάστασή του.

Η χρήση του προϋποθέτει την παροχή πρόσβασης για κάθε δοκιμή. Η επέκταση ακούει μόνο μερικά δευτερόλεπτα του deepfake πριν λάβει την απόφασή της. Ωστόσο, εστιάζει στον ήχο για την ανίχνευση του deepfake, οπότε τα βίντεο χωρίς ήχο δεν θα μπορούν να ελεγχθούν. Μόλις του ζητήσετε να αναλύσει την ενεργή καρτέλα σας στο Chrome με αναπαραγωγή ενός βίντεο, το ιστορικό του προηγούμενου ελεγχόμενου περιεχομένου θα εμφανιστεί παρακάτω στην επέκταση σε περίπτωση που θέλετε να επανεξετάσετε τυχόν αποτελέσματα.

Η εταιρεία ανάπτυξης της επέκτασης λέει ότι κυκλοφορεί το εργαλείο τώρα για να βοηθήσει να αποτραπεί η εξαπάτηση των θεατών από τα πολιτικά deepfakes τις εβδομάδες που προηγούνται των ομοσπονδιακών εκλογών στις ΗΠΑ. Σημαντικές πολιτικές προσωπικότητες έχουν ήδη υποστεί εκτεταμένα deepfakes, από τα ρομποτικά τηλεφωνήματα του προέδρου Μπάιντεν νωρίτερα φέτος μέχρι τα deepfakes της αντιπροέδρου Καμάλα Χάρις και τις εικόνες τεχνητής νοημοσύνης που φαντάζονται τους θαυμαστές της Τέιλορ Σουίφτ να υποστηρίζουν τον Ντόναλντ Τραμπ.

«Στη Hiya, δεσμευόμαστε να καταπολεμήσουμε τις απάτες, και την παραπληροφόρηση», αναφέρει σε δήλωσή του ο πρόεδρος της Hiya, Kush Parikh. «Τα deepfakes γίνονται όλο και πιο δύσκολο να εντοπιστούν, καθιστώντας δύσκολη τη διάκριση μεταξύ πραγματικού και κατασκευασμένου περιεχομένου. Η κλωνοποίηση φωνής, αν και αποτελεί μια απίστευτη τεχνολογική καινοτομία, αξιοποιείται επίσης από εγκληματίες του κυβερνοχώρου για απάτες, ακόμη και για να προσπαθήσουν να επηρεάσουν σημαντικά γεγονότα όπως οι εκλογές».

Το PCMag δοκίμασε την επέκταση Hiya σε μια σειρά από βίντεο, συμπεριλαμβανομένου ενός βίντεο όπου deepfakes των Trump και Biden ανταλλάσσουν αιχμές σε μια καθιστική συνομιλία. Η επέκταση της Hiya έδωσε στο βίντεο 59/100 στο «Authenticity Score», μαζί με μια σημείωση: «Τα μοντέλα μας είναι αβέβαια για αυτή τη φωνή». Αυτό είναι κάπως καθησυχαστικό, αλλά είναι λυπηρό ότι η επέκταση δεν ήταν σε θέση να αποφασίσει με μεγαλύτερη βεβαιότητα ότι το βίντεο ήταν ένα deepfake.

Συχνά, όμως, είναι ακριβές. Ένα πραγματικό video με τον Elon Musk να μιλάει για τα κρυπτονομίσματα επιβεβαιώθηκε σωστά ως «πιθανότατα αυθεντικό» σε μια δοκιμή του PCMag με τη χρήση του Hiya. Η επέκταση ήταν επίσης σε θέση να αναγνωρίσει σωστά προφανή deepfakes του Musk ως «πιθανότατα deepfake» και ένα deepfake της αντιπροέδρου των ΗΠΑ Kamala Harris να μιλάει με τον υποψήφιο σύντροφό της κυβερνήτη Tim Walz, δίνοντας και στα δύο χαμηλή βαθμολογία εμπιστοσύνης.

Αν δεν είστε σίγουροι για ένα αποτέλεσμα, μπορείτε να δοκιμάσετε να το βάλετε να αναλύσει πολλά διαφορετικά μέρη μιας εγγραφής για να δείτε αν αυτό παρουσιάζει μια πιο ξεκάθαρη ανάγνωση. Διαφορετικά, θα πρέπει να κάνετε τη δική σας έρευνα και γενικά να είστε επιφυλακτικοί απέναντι στο εντυπωσιακό περιεχόμενο που δημοσιεύεται στα μέσα κοινωνικής δικτύωσης. Υπάρχουν όμως και άλλοι τρόποι για να εντοπίσετε τα deepfakes, όπως το να ζητήσετε από ένα άτομο σε μια ζωντανή μετάδοση να γυρίσει στο πλάι ή να ακούσετε για μια παράξενη χροιά στη φωνή κάποιου. Τα κακά deepfakes μπορεί να είναι θολά ή να ακούγονται σαν να έχουν κοπεί κλιπ ήχου, αλλά τα καλά deepfakes μπορεί να είναι πιο δύσκολο να εντοπιστούν.

Η πρόσβαση στο Hiya είναι δωρεάν προς το παρόν κατά τη διάρκεια της προεκλογικής περιόδου. Ωστόσο, δεν είναι σαφές εάν ή πότε η εταιρεία θα αρχίσει να χρεώνει την πρόσβαση σε αυτό σε μεταγενέστερη ημερομηνία, αν και άλλα εργαλεία ανίχνευσης deepfake υπάρχουν ήδη εδώ και χρόνια. Το YouTube ανακοίνωσε πρόσφατα το δικό του εργαλείο ανίχνευσης deepfake για τον ιστότοπό του για βίντεο, αλλά για αρχή θα είναι διαθέσιμο μόνο σε επιλεγμένους δημιουργούς.